A favor de la prohibición de las redes sociales a menores de 16 años

Con un pero: la medida se queda muy corta

Pedro Sánchez anunciaba el pasado martes que el Gobierno de España quiere prohibir el acceso a las redes sociales a menores de 16 años, y claro, algo me toca decir desde el atolón reflexivo del Kiribati por cercanía temática. En el título del texto de hoy lo dejo claro: elevar la edad de consentimiento digital a los 16 años (actualmente en catorce) y prohibir el acceso a estas redes por debajo de este umbral es, sin duda, una medida necesaria. Sin embargo, si nos detenemos en el aplauso fácil a esta propuesta, corremos el riesgo de caer en una ingenuidad política peligrosa. Celebrar esta prohibición como la solución es como poner una valla coja de una pata en un acantilado mientras el suelo bajo nuestros pies se desmorona de tanta lluvia como está cayendo.

La medida es correcta, sí, pero también es epidérmica. Se ataca el acceso al síntoma, pero se deja intacta la arquitectura de la enfermedad. El problema no es solo que un menor de 14 o 15 años (o incluso menos) acceda a TikTok o a Instagram; el problema es que hemos permitido que las corporaciones transnacionales que rigen estas redes diseñen infraestructuras digitales cuyo modelo de negocio depende biológica y económicamente de la erosión continua de nuestra capacidad cognitiva. Limitar la edad es un cortafuegos en un incendio forestal, y lo que necesitamos es repensar por qué permitimos que se vierta gasolina en el ecosistema mental de la ciudadanía. Y esto incluye también a los mayores de dieciséis.

La literatura científica lleva años, casi una década, alertando de cambios estructurales y funcionales en el cerebro humano derivados de los dispositivos y mecanismos que usan las plataformas que viven de la economía de la atención. Por ejemplo, ya en 2017, un estudio titulado Brain Drain: The Mere Presence of One’s Own Smartphone Reduces Available Cognitive Capacity evaluó el desempeño en memoria de trabajo e inteligencia fluida bajo tres condiciones: teléfono en el escritorio, en el bolsillo o en otra sala. Los resultados, aterradores, demostraron que la mera proximidad física del dispositivo (incluso silenciado y boca abajo) reducía drásticamente la capacidad cognitiva disponible. El cerebro, acostumbrado a la tendencia a la hipernotificación de las redes, se veía obligado a destinar recursos atencionales finitos a inhibir el impulso de uso, generando un coste de oportunidad cognitivo que operaba de forma inconsciente y automática. Como hipótesis, si esto ocurre en adultos, imaginad cuál es el impacto en la neuroplasticidad adolescente, todavía en pleno proceso de poda sináptica1.

Dos años más tarde, una revisión titulada The 'online brain': how the Internet may be changing our cognition advirtió sobre cómo los flujos de información fragmentada y las recompensas variables intermitentes (pensad en el scroll infinito de las redes, los reels aleatorios, las dinámicas algorítmicas de recomendación…) se asociaban con alteraciones en las estructuras del lóbulo prefrontal, encargado del control inhibitorio y la planificación a largo plazo. Con las RRSS estamos, literalmente, entrenando a la ciudadanía del futuro para la impulsividad y la incapacidad de procesar la complejidad en cualquiera de sus formatos2.

Quienes somos educadores, lo vemos en las aulas: resistencia a la lectura profunda y pausada, ansiedad ante el silencio y dificultad para sostener argumentos que requieran más de treinta segundos de ilación lógica3. Permitir que algoritmos depredadores colonicen las mentes en formación de la ciudadanía del futuro es una cuestión de salud pública, no de libertad de mercado; y, a medio/largo plazo, es también una amenaza a la calidad democrática (escuchaba en la SER ayer por la mañana… ¿acaso habría llegado Trump al gobierno sin redes sociales?).

Sobre esa “crisis de salud pública” de la que hablo también hay un trabajo reciente que me parece difícil de obviar: un estudio que siguió durante años trayectorias personales de uso adictivo (de redes, móvil y videojuegos) en una cohorte grande. El estudio analizaba a miles de adolescentes y detectó que casi un tercio presentaba una trayectoria creciente de uso adictivo de redes sociales (sobre todo a través del móvil) a lo largo de cuatro años. Pues bien, quienes estaban en trayectorias crecientes mostraban riesgos significativamente mayores de conductas e ideación suicida, y peor salud mental en comparación con aquellos con trayectorias decrecientes4.

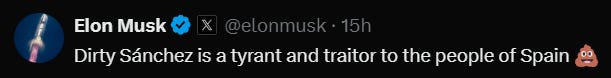

Y lo de la “amenaza a la calidad democrática” tampoco es una exageración o una cuñadez: hay evidencia reciente de que, por ejemplo, el orden algorítmico de los feeds en las redes sociales puede mover la aguja de la polarización afectiva (lo que sentimos hacia los que piensan distinto a ti) en periodos muy breves. En un estudio reciente publicado en Science se presenta un experimento con más de mil participantes en Twitter (X), en el que se usa un método independiente de la plataforma para reordenar lo que ve la gente en su feed. Con ayuda de un clasificador propio (y no del algoritmo opaco de la plataforma), identifican y reordenan publicaciones que expresan actitudes antidemocráticas y animosidad partidista; al reducir esa exposición a esos tuits (en solo 10 días), observaron que aumentaba de forma medible la “calidez/tolerancia” hacia la ideología contraria; al aumentar la exposición, ocurría lo inverso. Lo importante aquí, para nuestro debate, es verlo como mecanismo de manipulación política. Es peligroso porque la infraestructura, la red social, decide qué emociones se activan y con qué intensidad: puede amplificar (o amortiguar) el resentimiento intergrupal según convenga al producto, según interese vender (o no) polarización, odio y enfrentamiento. Dicho de otro modo: las redes no tienen que “convencerte” con un argumento; simplemente reordenando lo que ves te cambian el paisaje emocional de lo que consumes a diario. El ranking, el orden, lo que la plataforma prioriza para que lo veas primero, nunca es neutral: es un regulador de polarización afectiva5. Y por eso, como decía, no basta con poner una valla coja. Hacen falta cambios más profundos.

Por eso voy más lejos y critico la medida por quedarse corta. La prohibición a los 16 años es insuficiente porque trata a las redes sociales como un "lugar" al que se entra, en vez de entenderlas como un sistema extractivista que opera sobre la subjetividad y sobre la conformación de ciudadanía, que es después la que nos permite convivir con los demás.

El modelo de negocio de Meta (Instagram y Facebook), X (Twitter) o de Alphabet (Google) no es ofrecer servicios; es la minería de datos conductuales y la venta de futuros comportamientos humanos. Para maximizar esto, necesitan capturar la atención de forma agresiva a edades lo más tempranas que se pueda. Al igual que las industrias químicas del siglo XX vertían residuos en los ríos sin coste alguno, estas plataformas vierten "residuos cognitivos" (ansiedad, polarización, dismorfia corporal, déficit de atención…) en la sociedad. Economistas y teóricos sociales llevan tiempo señalando que estamos ante una época de externalidad negativa masiva. Las tecnológicas privatizan las ganancias (millones de horas de atención capturada) y socializan las pérdidas (sistemas de salud mental colapsados, fracaso escolar, agencia individual mermada, radicalización política y erosión democrática).

Aquí es donde el Estado debe ser radicalmente más punitivo y fiscalmente creativo. Si la lógica es el mercado, usemos las herramientas del mercado para corregir sus fallos. No basta con multas por protección de datos o con exigirles mecanismos que garanticen la edad necesaria para acceder; necesitamos parar las campañas de publicidad institucional en redes (ni un duro al salvaje oeste) y, además, una fiscalidad pigouviana aplicada a la economía digital. Igual que gravamos el tabaco, el alcohol o las emisiones de carbono porque reconocemos que generan un daño social que el Estado debe luego subsanar, debemos implementar un impuesto al despliegue y a la opacidad algorítmica, o un canon por contaminación cognitiva.

¿Cómo funcionaría?

Gravamen al diseño adictivo: Las plataformas que utilicen patrones oscuros (algoritmos en cajas negras que no conocemos cómo funcionan), scroll infinito o reproducción automática (características diseñadas para anular el autocontrol) deben pagar una tasa impositiva draconiana. Si su producto daña la cognición, su despliegue debe ser fiscalmente doloroso. Si con esto se plantan y no quieren proporcionar sus “servicios” en nuestro país, todos y todas ganamos.

Tasa de toxicidad algorítmica: Auditorías externas que midan la promoción de contenidos polarizantes o dañinos. A mayor viralidad artificial de contenidos nocivos, lesivos o en contra de los derechos humanos, mayor carga fiscal.

Impuesto a la disonancia lucrativa: Tolerancia cero con la hipocresía del target. Si una plataforma estipula en sus términos de uso que su servicio no es para menores (porque la ley lo fuerza a ello), pero simultáneamente permite a los anunciantes segmentar campañas hacia ese grupo demográfico (o hacia sus patrones de consumo e intereses específicos), se aplican sanciones automáticas. No es admisible que las tecnológicas se escuden en una barrera de edad performativa para eludir responsabilidades legales mientras monetizan por la puerta de atrás una audiencia que, según sus propias normas, "no existe". Si vendes su atención, asumes su protección.

Responsabilidad social: Las plataformas deben asumir el coste de los tratamientos de salud mental infantiles y juveniles. Parte de la recaudación de los impuestos anteriores iría directamente a reforzar la psicología clínica en la sanidad pública y a programas de alfabetización digital y algorítmica crítica en escuelas y centros de formación.

Soberanía cognitiva o barbarie. La medida de Sánchez es un primer paso, un reconocimiento tácito de que el laissez-faire digital ha fracasado. Se celebra. Pero prohibir a los menores de 16 años el acceso sin atacar el modelo de negocio subyacente es solo ganar tiempo.

Si no somos capaces de regular la infraestructura misma (los algoritmos de recomendación y la arquitectura extractiva de la adicción), esos jóvenes de 16 años llegarán a las redes igual de vulnerables, solo que un poco más tarde. La defensa de la capacidad cognitiva es la defensa de la libertad y de la humanidad misma. Un ciudadano incapaz de concentrarse, de leer profundamente o de resistir un impulso emocional, es un ciudadano fácilmente manipulable. ¿Necesitamos educación digital crítica? Por supuesto, pero no solo. También necesitamos mecanismos de salud pública, y estos deberían ir antes que los educativos.

Seamos duros y punitivos con la estructura misma del tecnofeudalismo actual. Por humanismo, por pura supervivencia intelectual de la especie. Si las tecnológicas quieren operar en nuestro territorio, que paguen el precio de la limpieza cognitiva que sus productos exigen. Y que dejen a la infancia en paz.

Acceso al texto completo: https://doi.org/10.1086/691462 | La investigación estableció tres condiciones experimentales: teléfono en el escritorio (boca abajo), en el bolsillo/bolso o en otra habitación. Los resultados mostraron una jerarquía lineal de deterioro: a mayor proximidad física, menor rendimiento cognitivo, siendo el grupo con el móvil en otra sala el único que mantuvo su capacidad intacta. Un hallazgo crítico para el debate educativo es la ausencia de consciencia metacognitiva: los participantes afectados negaron sentirse distraídos, lo que confirma que este drenaje cognitivo es un proceso automático que escapa a la introspección y al control voluntario del sujeto.

Acceso al texto completo: https://doi.org/10.1002/wps.20617 | Esta revisión sintetiza hallazgos de estudios de neuroimagen funcional (fMRI) y conductuales. Además del déficit atencional, el estudio destaca dos fenómenos críticos no mencionados en mi texto: 1) la consolidación de una "memoria transactiva", donde el cerebro reduce su capacidad de retención de datos al confiar en la nube como almacén externo (el conocido Google effect); y 2) evidencias de reducción de materia gris en el córtex cingulado anterior (ACC) en usuarios con alto uso de media multitasking (multitarea mediática), un área clave para la regulación emocional y la detección de errores, lo que sugiere un deterioro físico de las estructuras de autocontrol.

Este texto sobre mind wandering aporta luz al respecto: https://doi.org/10.1016/j.cedpsych.2022.102098

Acceso al texto completo: https://doi.org/10.1001/jama.2025.7829 | Otro hallazgo crítico de este estudio es la distinción ontológica que establecen los autores entre "tiempo de pantalla" y "uso adictivo": el estudio demostró que el tiempo total de exposición no se asoció significativamente con los resultados suicidas o de salud mental. La variable predictiva determinante fue exclusivamente la sintomatología adictiva (compulsión, dificultad para desconectar, angustia ante la privación), lo que sugiere que la intervención pedagógica y clínica debe centrarse en los patrones de vinculación con el dispositivo (el cómo) más que en la cronometría del uso (el cuánto).

Acceso al texto (se necesita acceder con cuenta institucional): https://doi.org/10.1126/science.adu5584 | Aquí la clave no es solo la reducción de la polarización, sino la validación de que el reordenamiento algorítmico (bajar la prioridad visual del contenido tóxico sin eliminarlo ni censurarlo) es una palanca causal suficiente para alterar la percepción del "otro" político, demostrando que la polarización afectiva es, en parte, un artefacto de la arquitectura de curación de contenidos y no solo una propiedad intrínseca de los usuarios. En el estudio lo hacen “para el bien”, imaginad cuando se hace para lo contrario.

Wow, me has volado la cabeza con muchas de las propuestas que viertes en este artículo. Ojalá el debate generalizado pudiera tener este nivel de profundidad cuando las medidas son tan controvertidas.

Me gustaría compartirte la única duda que me generan este tipo de prohibiciones, desde la experiencia micro y que no hago extensible al conjunto poblacional, porque carezco de la información para hacerlo. Desde la subjetividad, en resumen.

Como persona queer, lo que antes llamábamos redes sociales (ahora más plataformas de contenido o de venta online), me permitieron acceder a una gran cantidad de personas que me acompañaron y a las que acompañé durante momentos cruciales en mi desarrollo emocional. La familia, en estos casos, no siempre es el grupo primario que debería ser y la empobrecida actividad comunitaria existente en territorios como el mío, en la zona sur de una isla, no era punto de apoyo alguno. Ante esto, asumiendo que esta realidad la hayan vivido otras personas con características similares, me pregunto, ¿no estamos condenando a la chavalada a aprender a usar VPNs o a la soledad no elegida?

Entiendo que tenemos que elegir y sopesar reducción de daños pero, al mismo tiempo, me mueve la emotividad de pensar en lo que soy gracias a que existían estos espacios virtuales, ahora canibalizados hasta el extremo por el tecnocapitalismo.

Nada, solo una reflexión vaga.

Gracias por seguir escribiendo.

Esto es lo mejor que he leído sobre el tema y, en general, de lo más sensato, elocuente y educativo que he leído en mucho tiempo en Substack. Gracias, de corazón.